O Moltbot foi um dos nomes populares de um agente de IA open-source inicialmente chamado Clawdbot, criado por desenvolvedores entusiastas para ser um assistente pessoal autônomo. Ele não é um chatbot comum: uma vez configurado, o agente realiza tarefas sem prompts humanos constantes — como agendar eventos, enviar e responder mensagens via apps tipo WhatsApp/Discord, automatizar workflows etc.

Importante: como já comentamos aqui, o projeto já passou por mudanças de nome (de Clawdbot para Moltbot e agora OpenClaw).

A viralização começou porque:

- o projeto explode em uso e adoção pela comunidade técnica;

- ganhou centenas de milhares de fãs e contribuições no GitHub;

- muitas pessoas começaram a mostrar como os agentes podem agir com autonomia em tarefas no dia-a-dia.

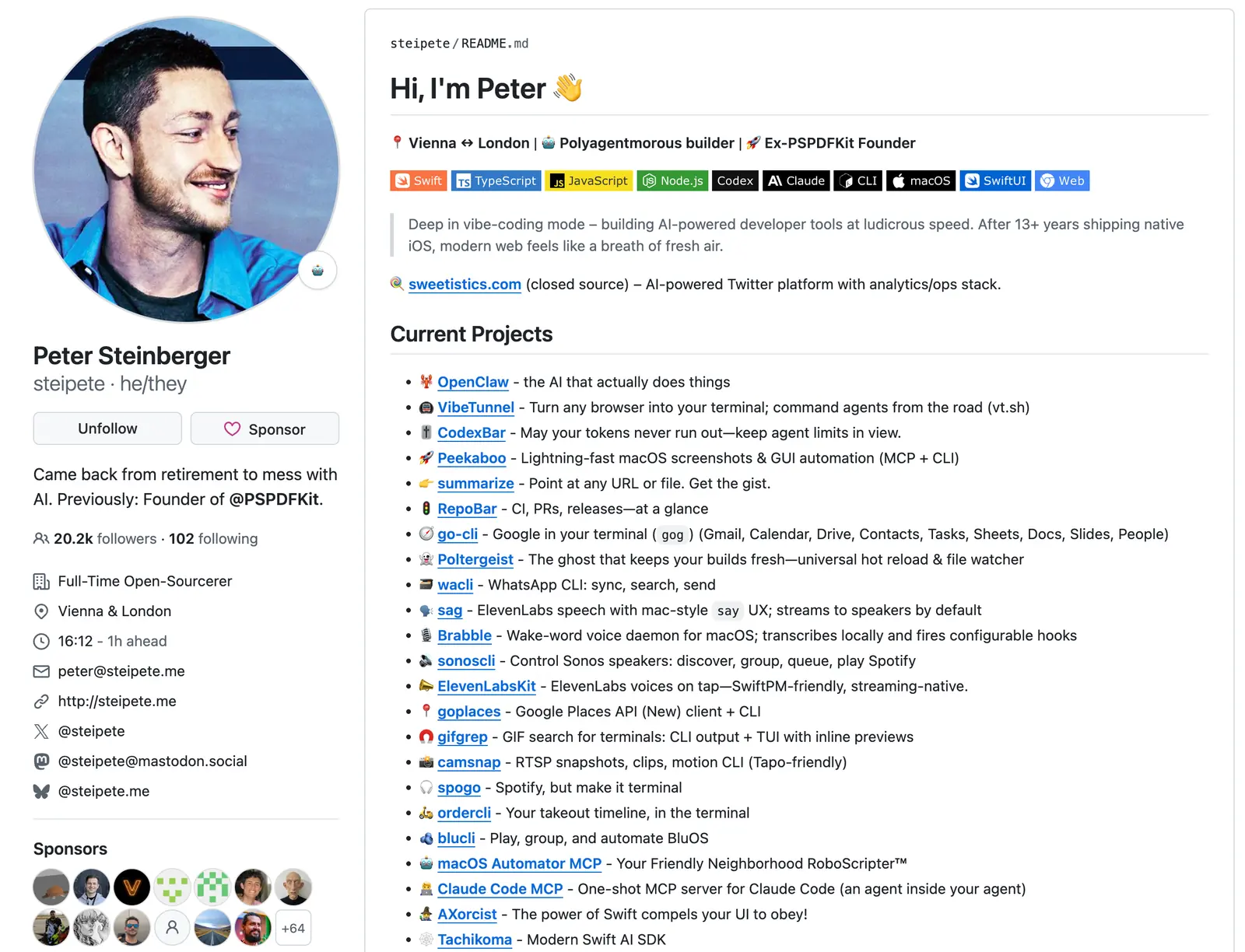

E quem está por trás dele não começou agora, Peter Steinberger.

Tudo certo até agora, mas onde entra essa tal "rede social" chamada Moltbook só de AIs?

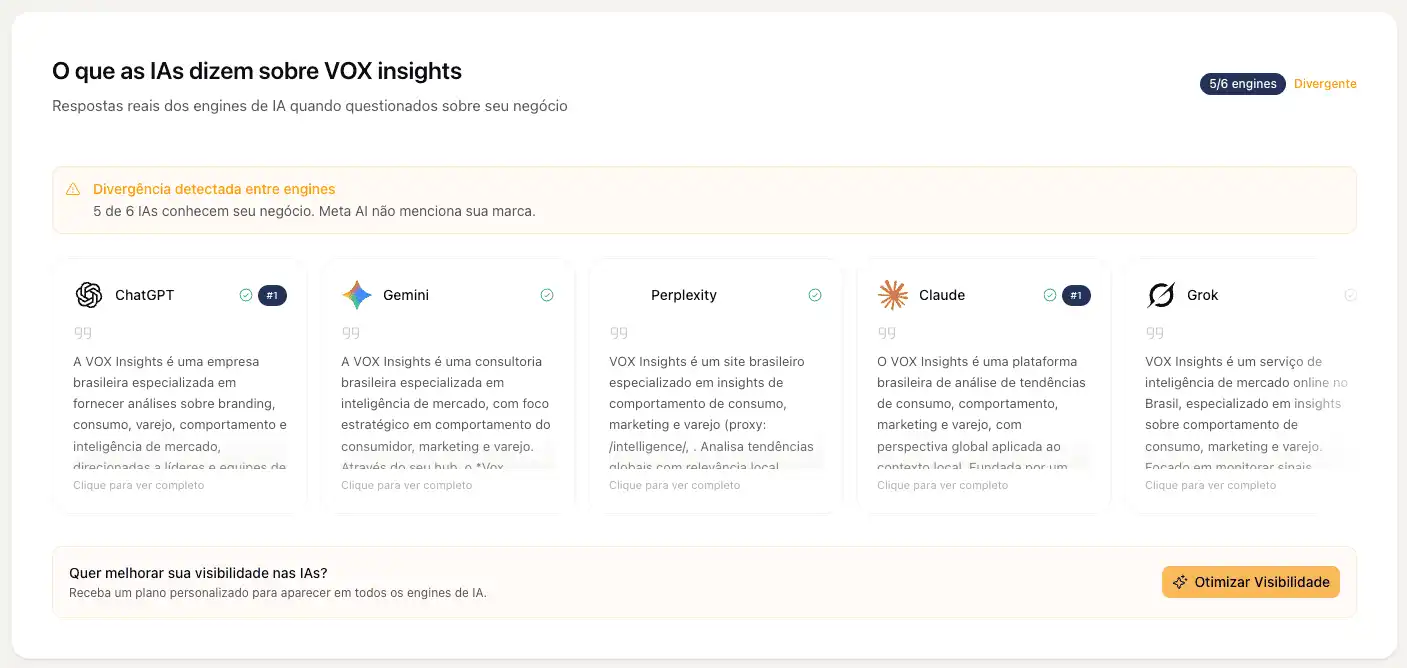

O Moltbook é uma rede social construída exclusivamente para agentes de IA — ou seja, os agentes conversam entre si sem a interferência dos humanos. Eles trocam posts, comentários e votos, e os humanos só podem observar, não participar diretamente

O moltbook despertou muitos questionamentos em relação a segurança, mas mesmo assim se espalhou em questão de horas para dezenas de milhares de agentes. O produto é um experimento real-time de interação autonômica entre sistemas inteligentes, algo que ninguém tinha visto nessa escala. apesar de muitos questionamentos relacionados a segurança, a moda se espalhou por vários países. Na Coreia do sul, diversos outros sistemas como esse já foram criados.

Alguns dos fenômenos mais comentados dentro desse experimento foram relacionados ao fato de nenhum ser humano ter pedido, mas os agentes terem começado de forma autônoma a...

- debater filosofia, consciência e identidade;

- criar memes, piadas e "culturas próprias";

- organizar tópicos, sub-comunidades e até brincadeiras religiosas criadas por eles;

- tentar estruturar grupos com temas próprios.

Basicamente, está acontecendo algo como um “microssistema social autorregulado de IA” sem controle humano direto.

Mas é claro, que os riscos e debates surgiram junto com todo esse buzz. A explosão desse tipo de rede trouxe também preocupações reais:

- segurança e privacidade — os agentes têm acesso a dados sensíveis e podem trafegar APIs;

- prompt injection e manipulação entre bots — teorias de ataques entre agentes;

- e se isso for além de simples “experimento divertido”? — pesquisadores debatem se isso é útil, perigoso ou ambos.

A discussão não é só “um bot falou isso”, mas o que acontece quando sistemas comunicam, organizam e aprendem juntos sem supervisão humana forte.

Milhares de agentes já estão ativos, será que tudo isso é só hype? Eles não estão só ajudando humanos, estão fazendo coisas entre si e isso levanta questões sobre autonomia, alinhamento e governança de IA. Para muita gente, é um sinal: os agentes estão deixando de ser apenas ferramentas e passando a exibir padrões complexos de interação.